はじめに──GPUは「ゲーム用」だけじゃない

PCの話をしていると、GPU=グラボ=ゲーム用というイメージが強いですよね。

でも実際のGPUは、映像を描くだけではなく「並列処理の塊」として、AIの学習や動画編集、科学計算まで幅広く支えています。

そのGPUの本領を引き出しているのが、NVIDIAの技術「CUDA(クーダ)」です。

今回はこのCUDAについて、できるだけ分かりやすくまとめていきます。

(とはいえ中身がけっこう濃いので、少し長めの記事になります)

CUDAって何?──グラボをゲーム以外にも使えるようにした技術

CUDAは「Compute Unified Device Architecture」の略です。

ざっくり言うと、GPUを汎用的な計算に使うための仕組みです。

もともとGPUは「画像を描くための専用チップ」でした。

でもCUDAの登場によって、画像以外の処理──たとえばAIの学習や動画のエンコード──にもGPUの計算力を使えるようになりました。

ひと言でまとめるなら、「グラボをグラフィック以外にも使えるようにした革命的な技術」です。

GPUとCPUの違い──得意分野がまるで違う

CUDAが何をしているかを理解するには、まずGPUとCPUの違いを押さえておくと分かりやすいです。

- CPU:少数のコアで高度な判断を素早くこなすタイプ

- GPU:数千もの小さなコアで単純な処理を一気にこなすタイプ

この違いを活かして、GPUは「大量の計算を同時に回す」ことが得意です。

ただし、GPUはもともと映像描画のために設計されたチップ。

「数千のコアをどう制御して、どうデータを送るか?」という問題を解決しないと、AI計算や科学処理には使えません。

そこで登場したのがCUDAです。

GPUにプログラム的な命令を出せるようにすることで、映像以外の処理もGPU上で動かせるようにしたわけです。

CUDAはNVIDIAだけの技術

ここが大事なポイントなんですが、CUDAはNVIDIAが独自に開発した技術です。

だからAMDやIntelのGPUでは動きません。

AMDは「ROCm」、Intelは「oneAPI」という別の仕組みを用意していますが、CUDAとの互換性はありません。

この「NVIDIAだけ」という独自性が、NVIDIAがAI分野で圧倒的に強い理由でもあります。

TensorFlowやPyTorchといったAIライブラリの多くがCUDAを前提に設計されていて、CUDA対応=開発効率が高い=採用されやすいという好循環ができあがっているんですよね。

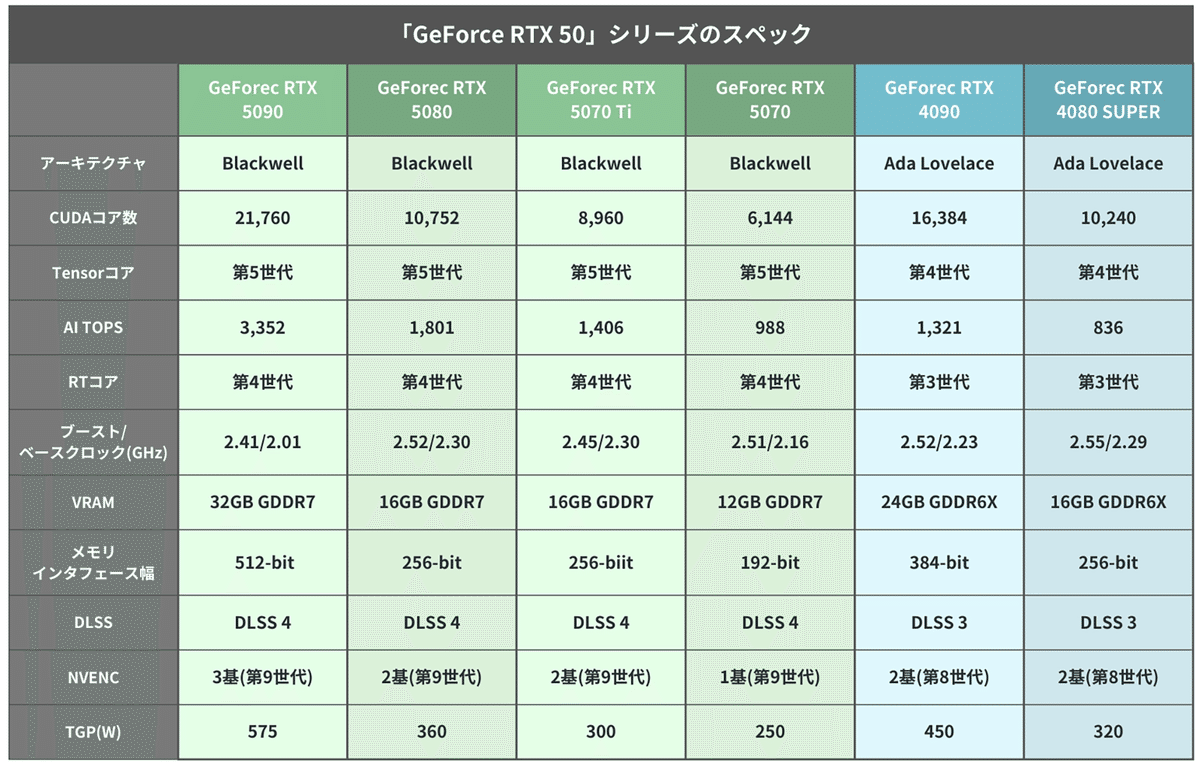

CUDAコアの「数」と性能の関係──多ければいいわけじゃない

よく「CUDAコア数=性能」と言われますが、実際はそう単純ではありません。

CUDAコアはGPU内部の演算ユニットの一部で、同じ数でも世代や構造によって性能はまったく変わります。

数が多いほど処理の並列性は上がりますが、同時にクロック速度、メモリ帯域、アーキテクチャの効率なども影響してきます。

たとえばRTX 5090とRTX 5060ではCUDAコアの数に数倍の差がありますが、単純に「5倍速い」とはなりません。

エンジンの気筒数で考えると分かりやすい

CUDAコアは、車で言えばエンジンの気筒数のようなもの。

多ければパワーは出せるけど、燃料(メモリ)や制御(ドライバ)が追いつかなければ、本来の性能は発揮できません。

魔理沙

魔理沙CUDAコアの数が多いGPUを買えば、とりあえず間違いないのか?

霊夢

霊夢数が多いほうが有利になりやすいのは確かだけど、それだけで決まるわけじゃないわよ。世代が違えば同じコア数でも処理効率がまるで変わるし、メモリ帯域やアーキテクチャの設計も効いてくるの。同じ世代の中で比べるなら、コア数の多いほうが強い傾向がある、くらいの理解がちょうどいいわね

AI・動画編集でCUDAが効く理由

AIの学習や動画編集は、ものすごく大量の計算を同時にこなす作業です。

AIなら「数百万のパラメータを一斉に更新する」必要がありますし、動画編集なら「フレームごとのエフェクト処理」を何百回も繰り返します。

ここでCUDAが力を発揮します。

GPUが持つ数千個のコアを「AI演算」や「映像処理」に振り分けて、CPUだけでは追いつかない速度で一気に処理できるんです。

処理内容によっては、CPUのみと比べて数十倍速くなるケースもあります。

動画編集ソフトでの活用

Adobe Premiere ProやDaVinci Resolveは、CUDAを使ってエフェクトやカラー補正をGPU側で処理しています。

これによってCPUへの負荷を下げながら、レンダリングを高速化できるわけです。

CUDA対応ソフトがここまで多い理由

CUDAが強いのは、ハードの性能だけではありません。

開発者が使いやすい環境を早くから整えていたことも、大きな要因です。

NVIDIAは2007年頃から、C言語ベースでGPUを扱える開発環境(CUDA Toolkit)を提供していました。

その結果、研究者もエンジニアも「GPUで並列計算を動かすならまずCUDA」という流れができて、TensorFlow、PyTorch、Stable Diffusionといった主要AIツールが軒並みCUDAベースで動くようになったんです。

つまりCUDAは、“技術”であると同時に”エコシステム”でもある。

GPUの性能を引き出す仕組みと、それを支える開発者コミュニティの両方が、NVIDIAの最大の強みになっています。

AMDやIntelが追いつけない理由

AMDも「ROCm」、Intelも「oneAPI」で似たようなことをやっています。

ただ、CUDA対応のソフトやライブラリが圧倒的に多いため、互換を取ろうとしても完全には追いつけないのが現状です。

「CUDAに最適化されたプログラムを他社GPUで動かす」のは、理論上できても実用レベルでは難しい。

この「互換の壁」がNVIDIAの牙城を支えているとも言えます。

RTX 50シリーズとCUDAの進化

最新のRTX 50シリーズ(Blackwell世代)では、CUDAコアの構造自体がさらに改良されています。

演算効率が上がり、AIタスクでは専用のTensorコアと連携して、より高精度かつ低消費電力で処理できるようになりました。

※Tensorコアは、AI演算を高速化するための専用回路です。

CUDA自体も定期的にアップデートされていて、AI、物理シミュレーション、映像編集など多方面のソフトがその恩恵を受けています。

GPUが進化すればCUDAも進化する。

この両輪が、今のAIブームや動画制作の裏側を支えているんですよね。

CUDAが変えた「グラボの価値」

かつては「グラボ=ゲームのためのパーツ」でした。

でも今は、「CUDA対応GPU=汎用計算マシン」の時代です。

研究者も、映像クリエイターも、AIエンジニアも、同じGPUを使っています。

ゲームのフレームレートを上げるだけでなく、AIを学習させたり、映像を解析したり、音声を合成したり。

CUDAがあったから、GPUは「映像専用チップ」から「汎用計算デバイス」に進化できた。

そう言っても大げさではないと思います。

まとめ:GPUを本気で使うなら、CUDAは避けて通れない

CUDAは単なるNVIDIAの一機能ではなく、GPUという存在を次のステージに引き上げた仕組みです。

- CUDAのおかげで、GPUはゲーム以外にもAI・動画編集・科学計算に使えるようになった

- NVIDIA独自の技術なので、AMDやIntelのGPUでは使えない

- CUDAコアの数は性能の目安にはなるが、世代やアーキテクチャの効率も大きく影響する

- 主要なAIライブラリや編集ソフトの多くがCUDAを前提に設計されている

グラボを選ぶとき、ゲーム以外の用途(AI、動画編集、3D制作など)も視野に入れるなら、「CUDA対応かどうか」は重要な判断軸になります。今後AIや3D分野がさらに進化していく中で、CUDAの重要性はむしろ高まっていくはずです。NVIDIA製GPUが幅広い用途で選ばれ続けている理由は、ここにあります。

・関連記事もあわせてチェック

コメント